Комітет ICSU за свободу та відповідальність у сфері науки (CFRS) занепокоєний тим, що деякі з політик і практик, які зараз застосовуються науковими установами та видавцями журналів, можуть ненавмисно підірвати цілісність наукової літератури. До цього додається некритичне використання показників публікації як заміни незалежної експертної оцінки при оцінці наукової діяльності. Вказуючи на ці проблеми організаціям-членам ICSU, ми сподіваємося, що вони вживуть заходів для забезпечення якості наукового запису та сприяти обережному та критичному підходу до використання показників публікації в оцінці досліджень.

Питання, що хвилюють:

- При призначенні кар’єрних посад та присудженні грантів основним критерієм часто є публікація заявників, зокрема кількість та ймовірний вплив публікацій. Це ненавмисно створює стимули для повторюваних публікацій, розділених публікацій, малоцінних публікацій та почесного авторства.

- Імпакт-фактори журналу дають вказівку на середню кількість цитувань, яку слід очікувати для статті в певному журналі, але ці цифри легко інтерпретувати неправильно. Наприклад, на них може вплинути співвідношення рецензій до первинних робіт. Цитування будь-якої окремої статті можуть бути набагато вищими або нижчими, ніж очікувалося від імпакт-фактора.

- Хоча кількість цитувань може свідчити про якість публікації, це не обов’язково. Справді нові і дуже важливі статті можуть привернути мало уваги протягом кількох років після їх публікації. Неправильна стаття може генерувати кілька цитат із статей, які її спростовують, а кількість цитат може бути завищена шляхом самоцитування. Число цитувань також, як правило, більше для оглядів, ніж для первинних статей.

- Цінність, що приписується записам про публікації та цитування, може змусити вчених публікувати надто рано, або перебільшувати та надмірно інтерпретувати результати. У екстремальних ситуаціях це також може сприяти науковій неправомірній поведінці, коли результати фальсифікуються, фальсифікуються чи плагіатом.

- У результаті тиску на публікацію все більша кількість рукописів подається до кількох журналів, перш ніж вони остаточно прийняті. Це збільшує навантаження на рецензентів, що в кінцевому підсумку зменшує ретельність процесу рецензування. Багаторазове подання та рецензування однієї і тієї ж роботи може затримати повідомлення про важливі результати, і можна стверджувати, що збільшення кількості рецензій рідко запобігає остаточній публікації роботи низької якості.

- Дедалі популярнішими стають альтернативні засоби публікації в електронних архівах, які не перевіряються або не перевіряються фахівцями, на індивідуальних або інституційних домашніх сторінках чи в блогах. Хоча ці засоби масової інформації відкривають нові можливості та покращують загальний доступ до публікацій, вони також збільшують доступність менш важливої або, можливо, оманливої інформації.

CFRS стурбований тим, що поточна політика та практика можуть мати серйозний вплив на якість наукової роботи загалом і збільшувати тягар рецензентів журналів. Будь-яке непотрібне збільшення обсягу наукових публікацій загрожує належному процесу рецензування, який є важливим для підтримки стандартів точності та цілісності.

На додаток до своєї ролі у науковій публікації, Комітет розглядає сувору та неупереджену експертну оцінку як найважливіший механізм оцінки якості наукової роботи та наукових проектів. Встановлення та підтримка належних процесів експертної оцінки саме по собі є проблемою, і визнається, що використання кількісних показників і показників як доповнення до цього процесу може бути корисним. Однак очевидна простота та привабливість таких числових індексів не повинні приховувати їх потенціал для маніпуляцій та неправильного тлумачення, і тому їх слід використовувати лише з великою обережністю.

Оскільки норми щодо кількості публікацій, умов авторства та цитування відрізняються в різних областях, судження та політику часто краще виробляти колеги, які мають досвід у тій самій галузі. CFRS закликає організації-члени ICSU стимулювати обговорення критеріїв наукової оцінки, показників кар'єри та публікацій, з метою просування системи, яка може краще служити науці в цілому. Замість того, щоб вчитися виживати в культурі «публікувати або загинути», молодих вчених слід заохочувати та підтримувати у створенні високоякісних наукових повідомлень, які роблять реальний внесок у науковий прогрес.

Питання для розгляду щодо використання показників при оцінці ефективності дослідження включають:

- Який оптимальний баланс між безпосереднім експертним оглядом, включаючи читання відповідних статей, та використанням кількісних показників на основі публікаційних записів, при оцінці заявок на гранти та посади?

- При оцінці записів публікацій та ефективності, яке зважування слід застосувати до номера публікації, факторів h, імпакт-фактору журналу, номера цитування, первинної публікації та огляду?

- Зауваживши, що угоди суттєво відрізняються від однієї галузі до іншої, скільки слід віддавати першому авторству, останньому авторству, середньому авторству чи відповідному авторству? У деяких сферах поширеність «авторства-привида» також викликає значне занепокоєння*.

- Яку оцінку слід віддавати попереднім видам та іншим електронним публікаціям, незалежно від того, проходять вони рецензування чи ні? Чи слід брати до уваги такі показники впливу, як кліки, завантаження чи посилання?

- Чи слід обмежити кількість публікацій, які зараховуються до грантів або призначень? Наприклад, чи варто брати до уваги лише три найкращі публікації на рік? Чи варто взагалі карати вчених за авторство понад, скажімо, 20 публікацій на рік? [Такі обмеження можуть здатися суперечливими, але сприятимуть розвитку культури, в якій усі автори справді зробили внесок у публікації, на яких з’являються їхні імена.]

- Яку вагу слід надавати іншим кількісним показникам результатів досліджень, таким як заявки на патенти, видані патенти або патенти, ліцензовані?

Комітет усвідомлює, що обговорення багатьох із цих питань уже ведеться в деяких країнах і деяких галузях науки, але припускає, що дебати поширюються на всю міжнародну наукову спільноту. Сподіваємося, що світова наукова спільнота зможе скористатися досвідом окремих організацій, обмінюючись варіантами та стратегіями.

*Див., наприклад, Ross et al, JAMA 299, 1800-1812 (2008).

Доповнення

Під час розробки цього твердження Міжнародний математичний союз випустив звіт про статистику цитування, який є детальним критичним аналізом використання даних цитування для наукової оцінки. Основний висновок цього звіту: хоча наявність єдиного числа для оцінки якості справді проста, це може призвести до неглибокого розуміння чогось такого складного, як дослідження. Числа за своєю суттю не перевершують розумні судження.

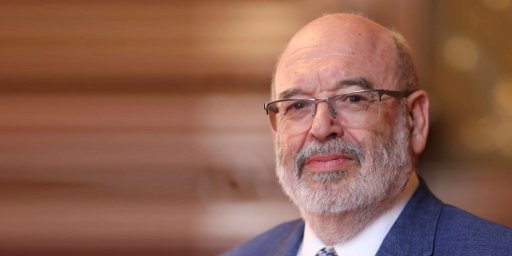

Про цю заяву

Відповідальність за цю заяву є Комітетом з питань свободи та відповідальності у сфері науки (CFRS), який є політичним комітетом Міжнародної ради з науки (ICSU). Це не обов’язково відображає погляди окремих організацій-членів ICSU.